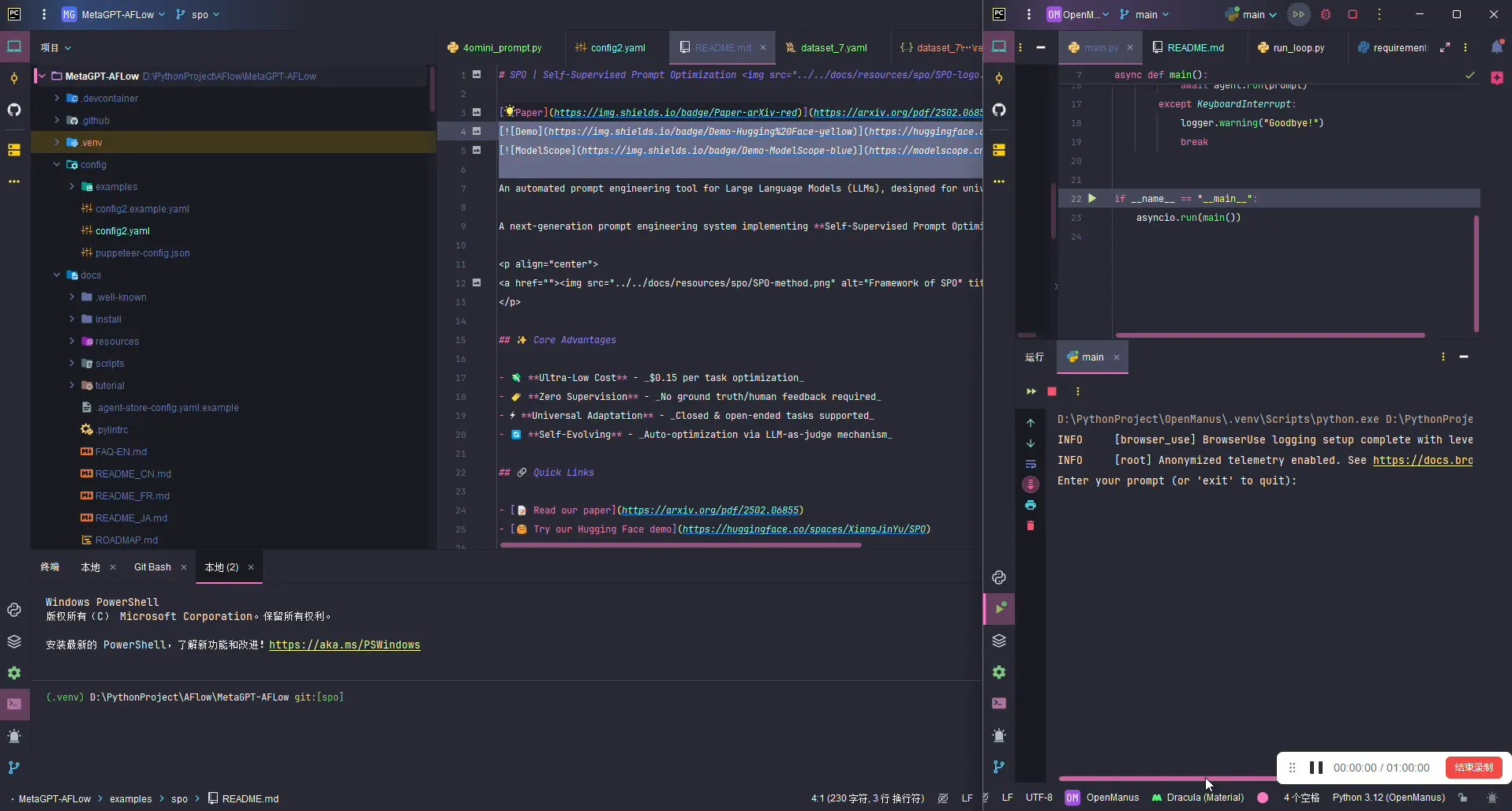

短短 3 天,39K Stars,Manus 开源版 OpenManus 彻底爆火!完全免费,无需等待,无需任何费用,无需APIKEY,直接对接我们本地的开源大模型!通过调用本地的 Ollama ,不要太香!

本地部署过程:

提前准备安装 python 3.12 【点击下载】和 conda 【点击前往】

下面我会提供两种不同的安装方法,分别适合Windows 和 macOS 、Linux用户

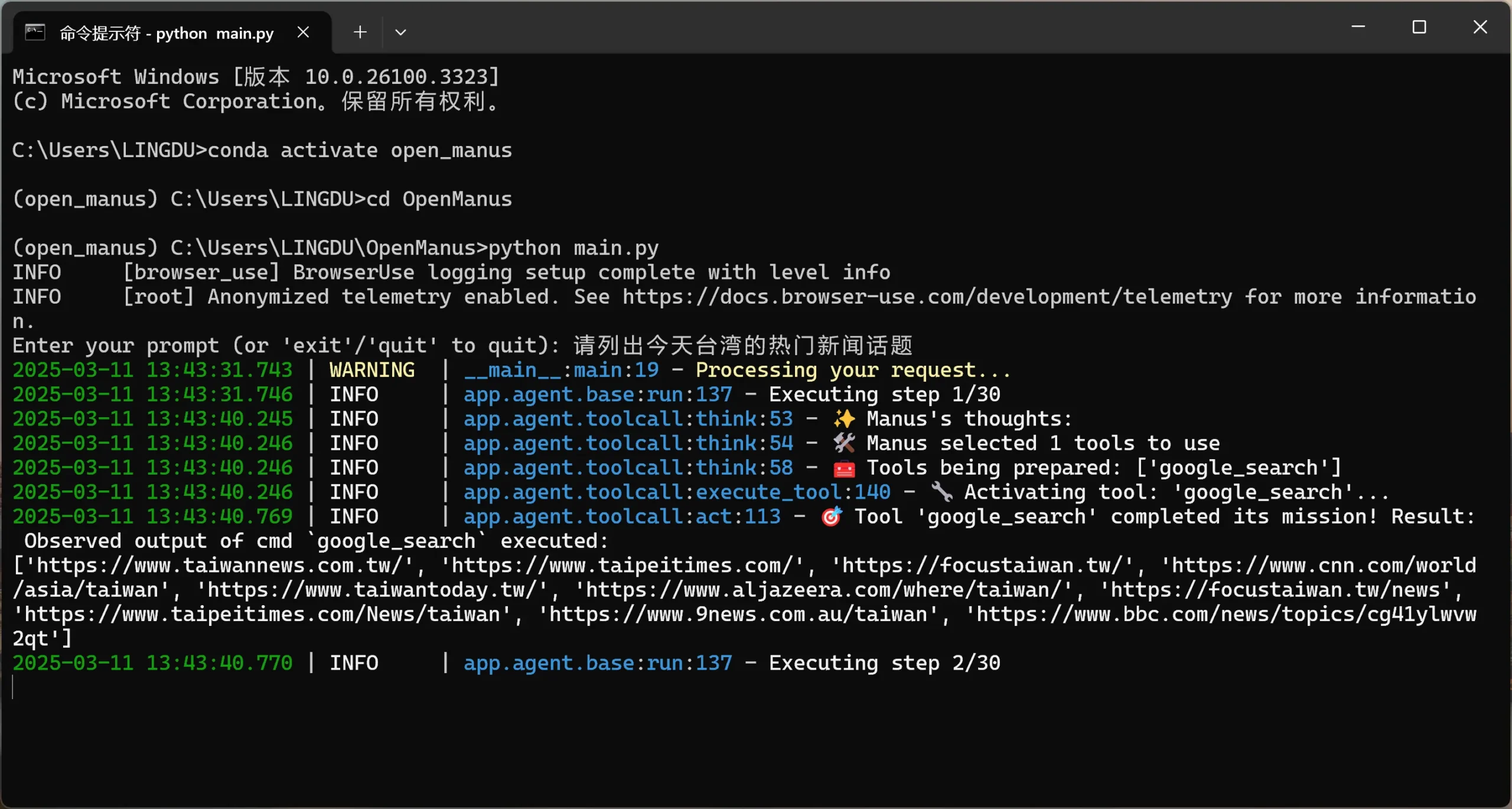

方法 1:使用 conda ( 适合 Windows 用户)

1、创建一个新的 conda 环境:

conda create -n open_manus python=3.12

conda activate open_manus2、克隆存储库:

git clone https://github.com/mannaandpoem/OpenManus.git

cd OpenManus3、安装依赖项:

pip install -r requirements.txt4、安装Ollama 本地部署AI大模型

Ollama 官方下载:【点击前往】

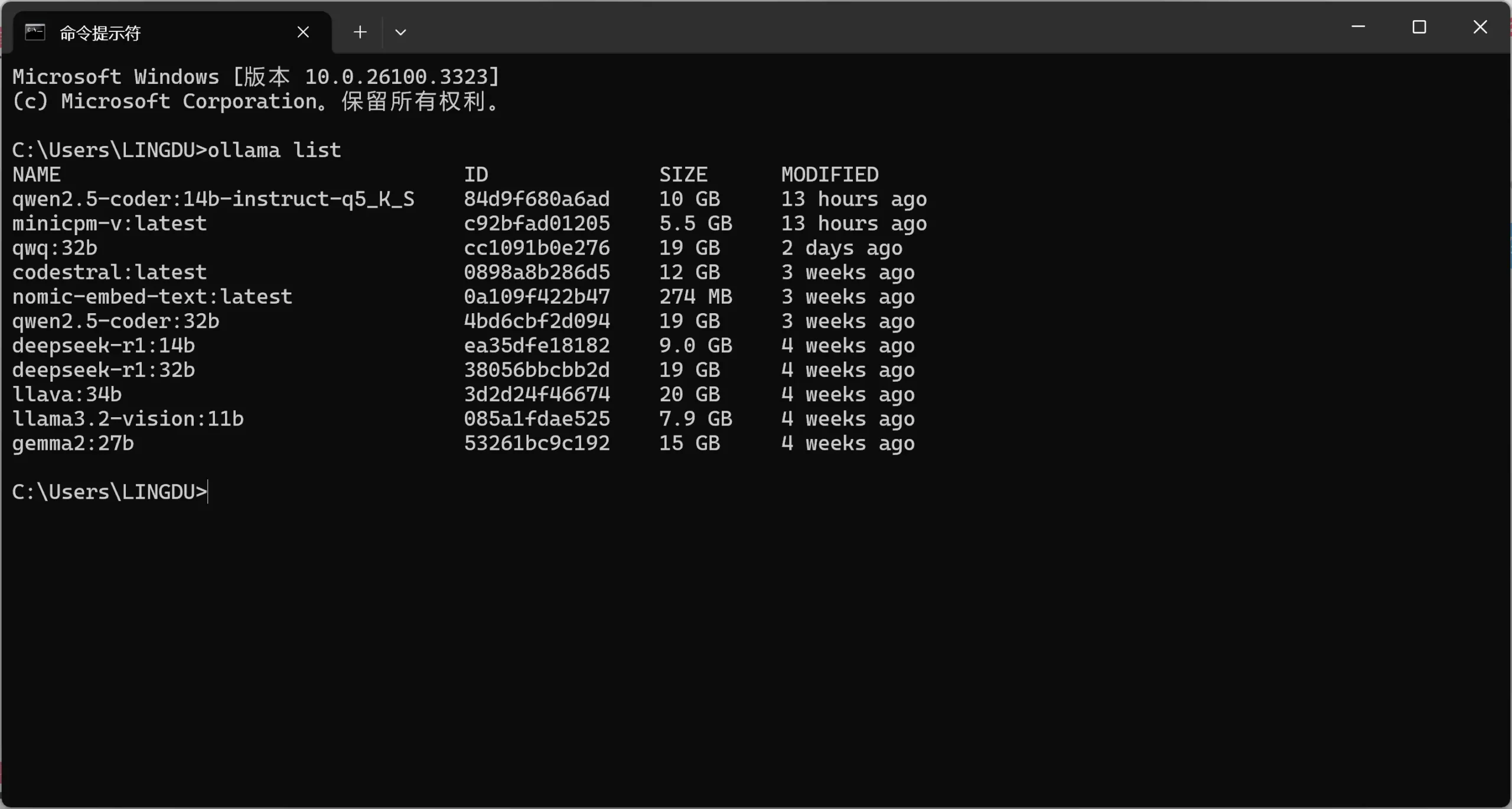

由于本地对接的AI模型,必须使用有函数调用的模型才可以, 比如 qwen2.5-coder:14b、qwen2.5-coder:14b-instruct-q5_K_S、qwen2.5-coder:32b 都可以,视觉模型可以使用 minicpm-v

本地模型安装命令:

ollama run qwen2.5-coder:14b视觉模型安装命令:

ollama run minicpm-v当然你可以安装任何你想要的,只要支持函数调用的模型就可以, 只需在安装命令 ollama run 后面跟上模型名称即可!

5、修改配置文件

在安装目录下,找到 OpenManusconfigconfig.example.toml ,把config.example.toml 改成 config.toml

然后将里面的内容改成如下:

# Global LLM configuration

[llm]

model = "qwen2.5-coder:14b"

base_url = "http://localhost:11434/v1"

api_key = "sk-..."

max_tokens = 4096

temperature = 0.0

# [llm] #AZURE OPENAI:

# api_type= 'azure'

# model = "YOUR_MODEL_NAME" #"gpt-4o-mini"

# base_url = "{YOUR_AZURE_ENDPOINT.rstrip('/')}/openai/deployments/{AZURE_DEPOLYMENT_ID}"

# api_key = "AZURE API KEY"

# max_tokens = 8096

# temperature = 0.0

# api_version="AZURE API VERSION" #"2024-08-01-preview"

# Optional configuration for specific LLM models

[llm.vision]

model = "qwen2.5-coder:14b"

base_url = "http://localhost:11434/v1"

api_key = "sk-..."注意:里面的模型文件名称要改成你自己安装的,后面的视觉模型可以和上面的一致,也可以自定义其它的视觉模型!

最后运行即可

python main.py详细的使用教程如下:

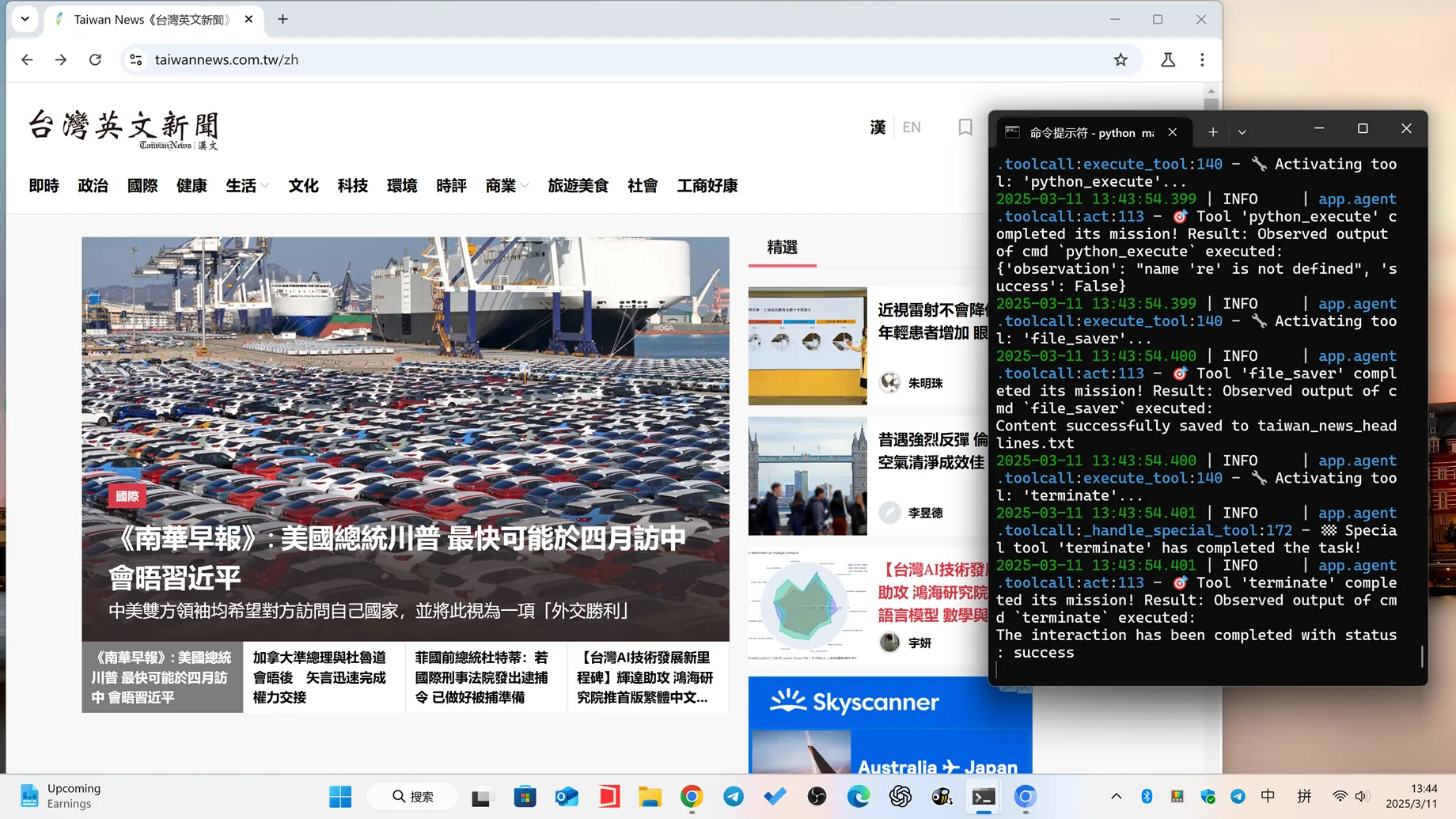

运行以后就可以进行使用了!它就可以完全自动调用浏览器,打开并浏览,查询并收集需要的信息

下次打开运行的命令如下:

conda activate open_manus

cd OpenManus

python main.py方法 2:使用 uv(适合macOS用户)

1、安装 uv(快速 Python 包安装程序和解析器):

curl -LsSf https://astral.sh/uv/install.sh | sh2、克隆存储库:

git clone https://github.com/mannaandpoem/OpenManus.git

cd OpenManus3、创建一个新的虚拟环境并激活它:

Windows 系统

uv venv

.venvScriptsactivatemacOS系统

uv venv

source .venv/bin/activate4、安装依赖:

uv pip install -r requirements.txt5、安装Ollama 本地部署AI大模型

更多内容,详细见零度教程

官方开源项目:【链接直达】

如何卸载已安装过的模型?在CMD终端下,通过命令:

ollama list # 查询已安装的模型

ollama rm 模型名称 # 卸载并删除模型

比如需要删除gemma2:27b 模型,那么只需输入:

ollama rm gemma2:27b即可删除模型

相关文章

- 1 Windows 11 开始默认不读取A:软驱

- 2 K歌必备神器!全民K歌、K歌达人 支持电脑 手机 电视TV

- 3 Windows 11 开始默认不读取A:软驱

- 4 GibberLink 神奇的两 AI 加密对话! 完全开源,本地部署教程!

- 5 震惊!AI 竟秘密通信,人类完全听不懂!太离谱了!免费开源,可本地部署 GibberLink | 零度解说

- 6 Winhance – Windows 11 系统增强实用工具,系统瘦身优化神器!

- 7 Windows 11 Debloater Tool (可视化 UI 版) ,免费开源,一键去除电脑臃肿功能!

- 8 Windows 11 卡顿、运行慢?试试这两款优化神器,让电脑丝滑流畅、极速起飞! | 零度解说

- 9 AI 太强了!几分钟生成一首原创音乐,真实又好听,教程来了! | 零度解说

- 10 OmniHuman-1 多模态 “真人”视频生成项目! 效果真不错

-

扫码下载安卓APP

扫码下载安卓APP

-

微信扫一扫关注我们

微信扫一扫关注我们

微信扫一扫打开小程序

微信扫一扫打开小程序

微信扫一扫打开小程序

微信扫一扫打开小程序

-

返回顶部

发表评论